目次

- なぜAI倫理とガバナンスが重要なのか

- 国際的なAI倫理・ガバナンスの議論動向

- 製造業でのAI活用例とリスクポイント

- AI倫理とガバナンスが求められる背景:データと自動化

- AIガイドラインの主な要件と製造現場への適用

- AI倫理・ガバナンスに基づく具体的施策の比較表

- 実装事例:FAプロダクツが支援するAI導入プロセス

- まとめ

なぜAI倫理とガバナンスが重要なのか

(1) AI活用の拡大と社会的インパクト

AI(人工知能)は、予測や最適化、意思決定支援など広範な分野で使われるようになっています。とりわけ製造現場では、設備データの自動解析や画像処理の検証などにAIが導入され、生産効率や品質向上に寄与しています。しかし、AIの判断が誤った場合、大規模な製品不良や設備停止など深刻なトラブルにつながるリスクがあります。

(2) 倫理的・社会的責任の高まり

AIが膨大なデータを扱うほど、個人情報や機密情報の取り扱いが問題となります。特に製造業でも、人事データやサプライチェーン情報をAIが処理するケースが増え、プライバシーや公正さが懸念される場面も。こうしたリスクを未然に防ぐために、AI倫理およびガバナンスの体制を整えることが急務です。

(3) 国際競争力とブランド価値

グローバル競争が激化する中、国際規格やガイドラインへの準拠が輸出や海外展開で必須になる可能性が高まっています。AI倫理を遵守し、安全・信頼性の高い製品を作れる企業は、取引先や消費者からの信用を得やすく、ブランド価値の向上にも寄与します。

国際的なAI倫理・ガバナンスの議論動向

(1) OECDのAI原則

経済協力開発機構(OECD)が策定したAI原則では、人間中心のAI開発・利用を促し、透明性や説明責任などを重要視。加盟各国がこれを基に国内指針を整備しており、製造業も例外ではなく、AIを導入する際に留意すべき点とされています。

(2) EUのAI Act

EUではAI Act(人工知能法)が進められており、AIシステムのリスク分類やコンプライアンス義務を定める法整備が進行中。製造業においては、ロボットや自動化ラインに導入されるAIが「高リスク」と分類される場合があり、厳格な要求事項に適合する必要が出てきます。

(3) UNESCOのAI倫理勧告

UNESCOでは、AI倫理に関する国際的な勧告を提示し、AI開発の公平性、プライバシー保護、環境負荷低減などを求めています。製造業では、サプライチェーン全体でこうした倫理基準を意識し、取引先とのデータ共有や責任分担を明確化することが大切です。

製造業でのAI活用例とリスクポイント

(1) 需要予測と生産計画

需要予測にAIを使うと、販売データや市場トレンドなどを解析して精度の高い予測が可能になります。これにより、生産ラインでの在庫削減やライン稼働率の最適化が見込まれます。半面、AIの誤予測やデータバイアスにより、過剰在庫や欠品リスクが生じる可能性も。

(2) 設備故障予測とFA装置のメンテナンス

振動センサーや温度センサーのデータをAI解析して設備の故障予兆を把握する振動予知保全などが注目されています。突発故障を防げる一方で、データ漏洩やアルゴリズムの過学習による誤報があると、ライン停止やコスト増が発生するリスクも。

(3) 品質検査・画像解析

画像処理の検証とAIの組み合わせで、自動外観検査や不良抽出が高精度化。ただし、AIモデルのバイアスや学習不足で特定の不良を検知できない場合、クレームやリコールにつながるリスクがある。

AI倫理とガバナンスが求められる背景:データと自動化

(1) データの偏りとバイアス

製造業でも、ある工程だけのデータや一部の生産条件に偏ったデータでAIを学習させると、異常なバイアスが生じて現場に合わない判断を下す恐れがあります。AI倫理の観点から、多様なデータ収集とバイアス検証が不可欠です。

(2) 自動化ラインへの責任所在

AIが自動的に判断を下すラインでは、責任所在が不明瞭になりやすいです。たとえば不良品が出ても「AIの判断が原因だった」として人が責任を負わないと、品質管理体制に穴が生じる可能性があります。ガバナンス体制を整え、どのレベルで人間の承認が必要かを明確化しなければなりません。

(3) 機密データと知的財産の保護

DX化が進むと、サプライチェーン全体で機密情報や生産ノウハウがデータとして流通します。AIの学習素材としてこれらのデータを利用する場合、企業間で知的財産の境界が曖昧になりかねません。契約やガイドラインを定め、情報漏洩を防ぐ仕組みが重要です。

AIガイドラインの主な要件と製造現場への適用

(1) 公正性と説明責任

AIが下す判断が公正であり、差別や偏見を含まないように設計することが求められます。製造業で具体的には、部品検査や人員配置AIが特定の属性を不当に扱わないか、説明責任を持ってモデルを検証する必要があります。

(2) プライバシーとデータ保護

作業員の生産性データや個人情報をAIで分析する場合、プライバシー保護や権限管理が課題となります。必要最小限のデータ収集と適切な暗号化を行い、流出リスクを最小化することが不可欠です。

(3) 安全性とリスク管理

ロボットや自動倉庫などでAIがリアルタイム制御を行う場合、機械安全や緊急停止の仕組みが適切に組み込まれているか確認する必要があります。国際安全規格に準拠し、安全柵やセンサを組み合わせた対策を講じることが求められます。

AI倫理・ガバナンスに基づく具体的施策の比較表

下記は製造現場でよく行われるAI実装施策と、それらをAI倫理・ガバナンス観点で強化する施策の一覧例です。

| AI導入施策 | 従来アプローチ | AI倫理・ガバナンス施策 |

|---|---|---|

| 振動予知保全 | センサー設置とモデル学習 異常時にアラート表示 | データバイアス検証 閾値設定に透明性を確保 責任分担(設備管理者・AI開発者) |

| 画像検査AI(外観検査など) | 有人ダブルチェック併用 AI判断が不正確な場合は人が再確認 | AIモデルの学習履歴・性能評価を定期的に公開 不良検知における誤報・見逃し率を監視 緊急時の手動介入ルール |

| 需要予測と生産計画 | 過去データで予測モデル構築 計画担当が結果を修正 | フィードバックループ整備 異常値やバイアス検知の仕組み MESと連動し自動制御は段階的に導入 |

| 作業者スケジュール最適化 | 人事部がスキルマッチング 現場とのコミュニケーション頼り | AIおすすめ案を説明可能化 透明な意思決定ロジック 偏りがないか定期レビュー |

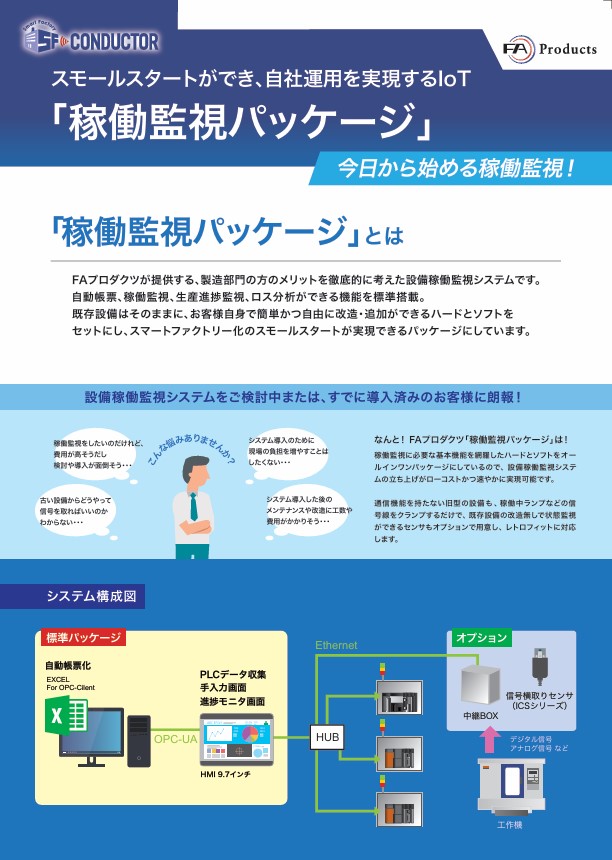

実装事例:FAプロダクツが支援するAI導入プロセス

以下は開発例として、FAプロダクツがAI倫理・ガバナンスに配慮しながら製造業のAI導入を支援した事例イメージを示します。

(1) ケース概要

- 業種:電子機器組立ライン

- 課題:作業者の属人的な判断に依存した品質検査や段取り替えが多く、ミスやライン停止が頻発。経営層はAIを導入したいが、現場は不安視している。

(2) ステップ1:現場ヒアリングとリスク分析 FAプロダクツのエンジニアが工程データ、品質不良の履歴を調査し、どの工程がAI導入効果を得やすいか分析。AIが誤検知した場合のリスクや個人データの扱いなど、倫理面・セキュリティ面の懸念を抽出。

(3) ステップ2:ポリシー策定と小規模PoC

- AI活用方針(公正性や責任分担など)を社内合意の上で策定

- 小規模ラインでPoC(概念実証)を実施し、AIモデルの精度や画像処理の検証を確認

- バイアス検証や説明責任を明確化して現場への不安を解消

(4) ステップ3:本格稼働と運用サポート

- AIモデルをMES導入と連携し、稼働データをリアルタイムで学習・更新

- FA装置のメンテナンスと組み合わせ、異常兆候を早期にアラート

- 定期的にAIの挙動をレビューし、責任所在と改善ルールを明文化

(5) 成果

- 不良発生率が半減し、突発故障によるライン停止も激減

- 従業員はAIによる監視ではなく、支援ツールとして受け入れ、モチベーション維持

- 経営層もガバナンス体制に納得し、今後さらにロボットや技術者派遣領域へのAI展開を検討中

まとめ

製造業でAIを活用し、生産効率や品質を高める取り組みが一般化するにつれ、AI倫理とガバナンスの重要性がますます高まっています。国際的な議論ではOECDやEUなどがガイドラインを整備し、日本国内でも多くの企業がそれを踏まえたデータ活用やリスク管理を進めています。とりわけ、製造現場では作業者の安全や製品品質への影響が大きいため、AI導入時の責任分担や説明可能性が厳しく問われるのです。

FAプロダクツでは、AIに特化したサービスだけでなく、シミュレーションやFA装置のメンテナンス、FA装置の開発・改造といった総合的なソリューションを展開しながら、AI倫理・ガバナンスを考慮したシステム導入を支援しています。適切な設計、セキュリティ、モニタリングの仕組みを構築することで、製造現場の生産効率と安全性を同時に高めることが可能です。

今後、AIの活用範囲はさらに拡大するでしょう。社内外での合意形成と長期的な視点を持ち、国際規格やガイドラインへの対応を進めることで、企業の競争力と社会的信頼の両面を向上させる道が開けるはずです。AIを導入したいが懸念を抱えている製造現場こそ、まずはAI倫理・ガバナンスの要点を理解し、安全かつ効果的にAIを使いこなす準備を整えてはいかがでしょうか。